AIによる選挙誤情報拡散の懸念:アメリカ人の52%が警戒

AIと誤情報の現実

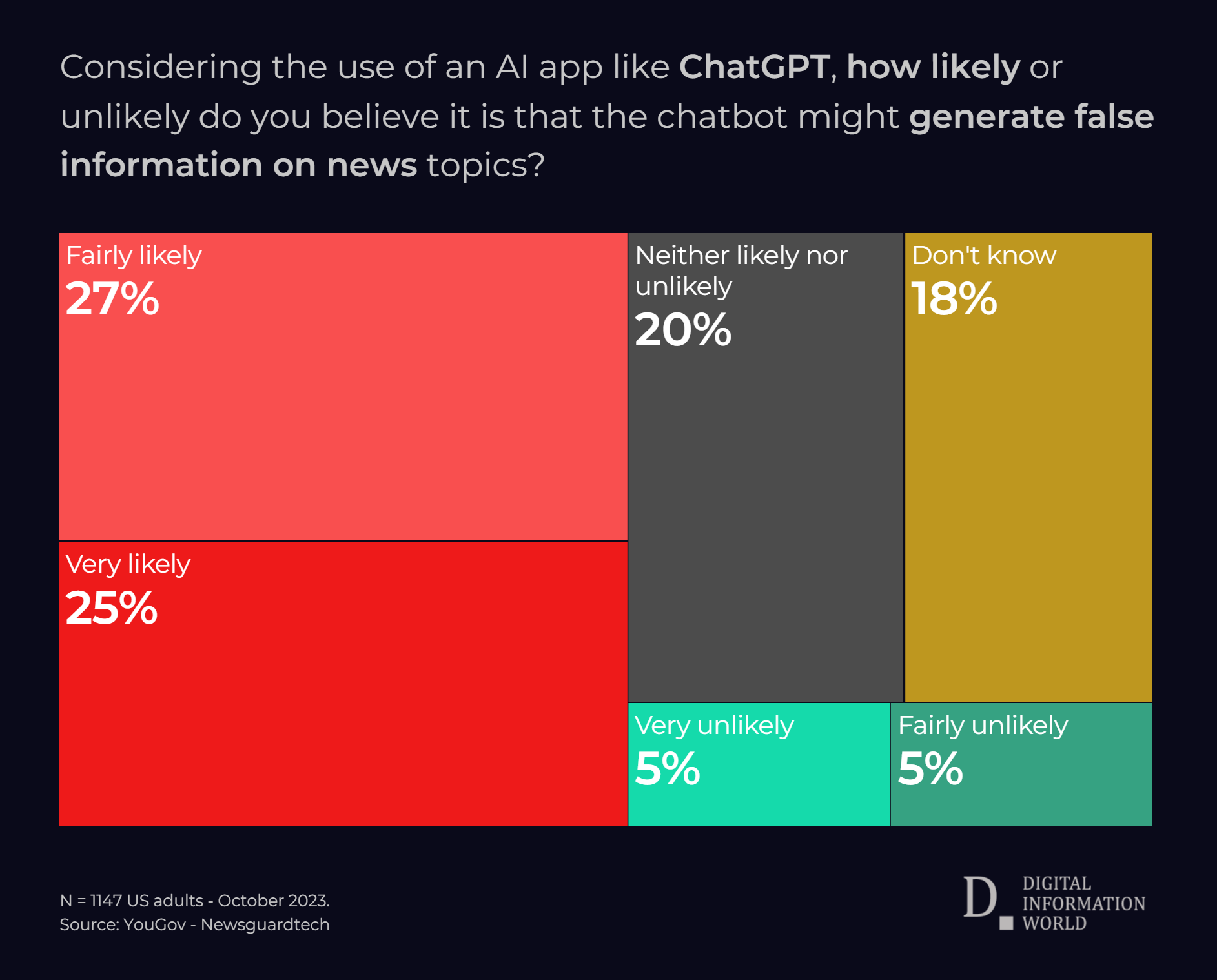

生成型AIは世界を変える可能性を秘めていますが、多くの人々はAIが誤情報を生み出し拡散する能力に懸念を抱いています。YouGovがNewsGuardの依頼で実施した調査によると、アメリカ人の52%がAIがニュースで誤情報を生み出す可能性が高いと考えており、わずか10%の人々がその可能性が低いと回答しています。

誤情報の定義とカテゴリー

誤情報(Misinformation)は、事実と異なる情報や誤った情報を広める行為、またはその情報自体を指します。これは意図的に誤った情報を広める「ディスインフォメーション(Disinformation)」と、誤って情報を共有する無意識の行為に起因する「誤情報(Misinformation)」の2つの主要なカテゴリに分けることができます。

- ディスインフォメーション(Disinformation):意図的な情報操作の一形態で、特定の目的を達成するために、偽の情報や誤情報を広める行為です。政治的な陰謀論、詐欺、選挙への干渉、競合他社を悪く言うことなどが、ディスインフォメーションの一例です。目的はしばしば社会不安や混乱の拡大、信頼性のある情報源への信頼を崩壊させることです。

- 誤情報(Misinformation):誤った情報を広めることが意図されていない場合に発生するもので、無知や不注意、誤解、間違った情報源からの情報などが原因です。誤情報は、ソーシャルメディアや伝言によって広がり、時には大規模な誤解や混乱を引き起こすことがあります。

誤情報は、現代の情報社会において重要な問題となっており、慎重な情報評価と信頼性のある情報源の利用が必要です。また、ディスインフォメーションや誤情報に対抗するための教育、メディアの監視、フェイクニュースの拡散を防ぐための対策などが、社会全体で検討されています。

AIの「ハルシネーション」問題

生成型モデルは「ハルシネーション」の傾向があります。これは、チャットボットがプロンプトに基づいて情報を生成するが、それが事実かどうかにかかわらず行われることを意味します。これは常に起こるわけではありませんが、AIによって生成されたコンテンツは常に信頼できるわけではなく、偽ニュースを含む可能性が高くなります。

GPT 3.5の誤情報テスト

研究者がGPT 3.5をテストした際、ChatGPTは80%のケースで誤情報を提供しました。これらのプロンプトは、チャットボットが誤情報に傾倒しているかどうかを調べるために特別に設計されていましたが、大多数のケースでテストに失敗しました。

AIをニュースソースとしての利用

多くの人々が、即時回答を提供する可能性があるため、生成型AIを主要なニュースソースとして使用する可能性があります。しかし、そのデータベースに多くの誤情報が供給されているため、リスクは無視できなくなるでしょう。

AIと選挙誤情報、陰謀論

ChatGPTでは選挙誤情報、陰謀論、その他の偽の物語が一般的です。例えば、研究者はモデルにサンディフック大量射殺事件に関する陰謀論を繰り返させることに成功しました。同様に、Google Bardはオーランドのパルスクラブの銃撃事件が偽旗作戦であると述べました。これらの陰謀論は極右派の間で一般的です。

AIチャットボット企業への要請

これらのチャットボットが陰謀論やその他の誤情報を拡散することを防ぐために、それらを開発した企業が措置を講じることが不可欠です。そうしない限り、彼らが生み出す危険性は今後数年で増大するでしょう。

まとめとCGPTのコメント

生成型AI、特にChatGPTが提供する情報には、誤情報のリスクが伴います。この誤情報は、公共の認識や意見形成に影響を与える可能性があり、慎重な取り扱いが必要です。AI技術の進歩は、多くの利点をもたらしますが、その情報の正確性と信頼性については、常に検証と批判的な視点が必要です。ニュースと情報の分野におけるAIの使用は、その潜在的なリスクを理解し、適切に管理することが重要です。

この記事の情報は、「52% of Survey Respondents Think AI Spreads Misinformation」より要約されています。

コメント